EDUCAUSE 2025人工智能全景研究

2025-05-28 中国教育网络

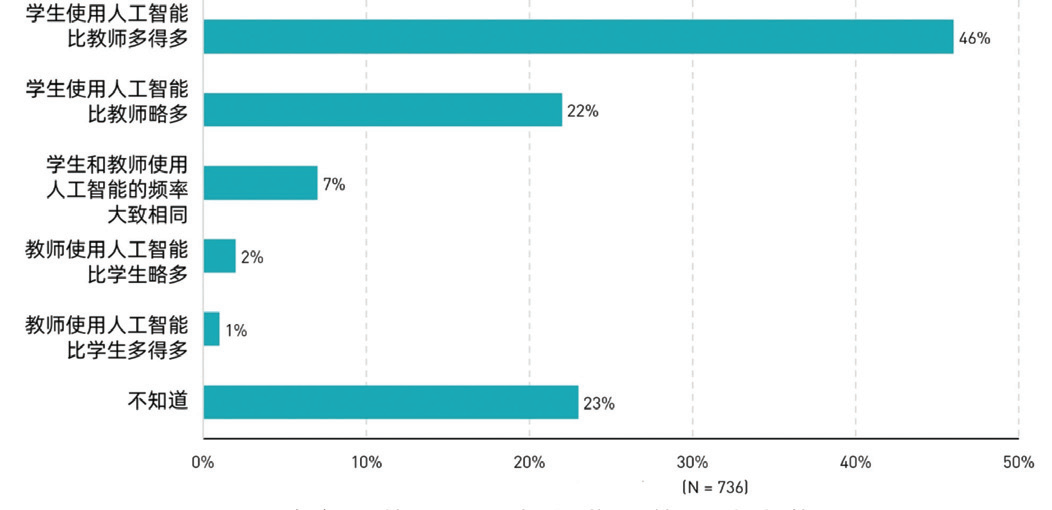

68%的受访者表示,学生使用人工智能的频率比教师“略高”或“高得多”

高等教育界一直致力于解决如何在学习和工作中使用人工智能(AI)的问题。为支持相关工作,EDUCAUSE发布2025年人工智能全景研究报告,总结高等教育界在战略与领导力、政策与指南、应用案例、高校员工队伍以及学校数字鸿沟等方面与人工智能相关的观点和实践。

本研究采用2020年美国《国家人工智能法案》对人工智能的定义:“一种基于机器的系统,能够针对一组既定的人为定义目标,做出影响真实或虚拟环境的预测、建议或决策。”

战略与领导力

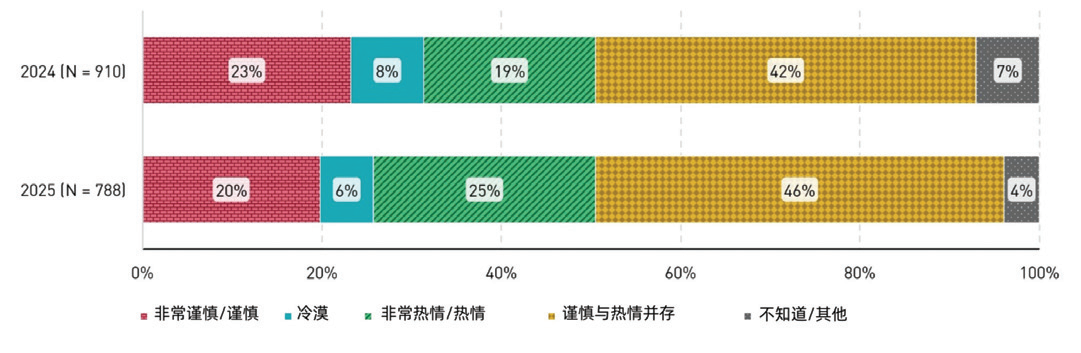

高校人工智能战略的现状既显示出进步的迹象,也显示仍有更多工作需要开展。今年,超过半数(57%)的受访者认同或强烈认同“我们将人工智能视为战略重点”,高于去年的49%。学校领导者对人工智能的态度似乎也在逐渐升温(如图1),在受访者看来,领导者的态度稍微向乐观方面转变。

图1 学校领导者对人工智能总体态度的印象

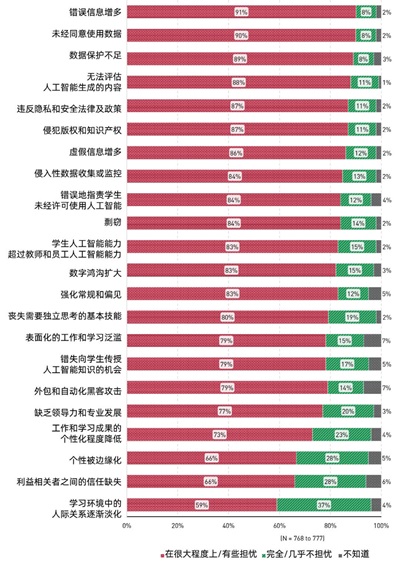

大多数受访者对人工智能风险表示担忧。在调查的22个与人工智能相关的潜在关注领域中,超过四分之三的受访者表示,他们对其中18个领域“有些担忧”或“非常担忧”(如图2)。调查显示,对人工智能的伦理滥用(错误信息、虚假信息和版权/知识产权侵权)以及对安全和隐私(未经同意使用数据、数据保护不足)的担忧,似乎对受访者尤为重要。人工智能使用中更具“人性”的方面,如人际关系的淡化、个性化工作和学习的丧失,似乎不那么令人担忧,尽管大多数受访者仍然对此表示关注。

图2 对人工智能政策的态度

政策与指南

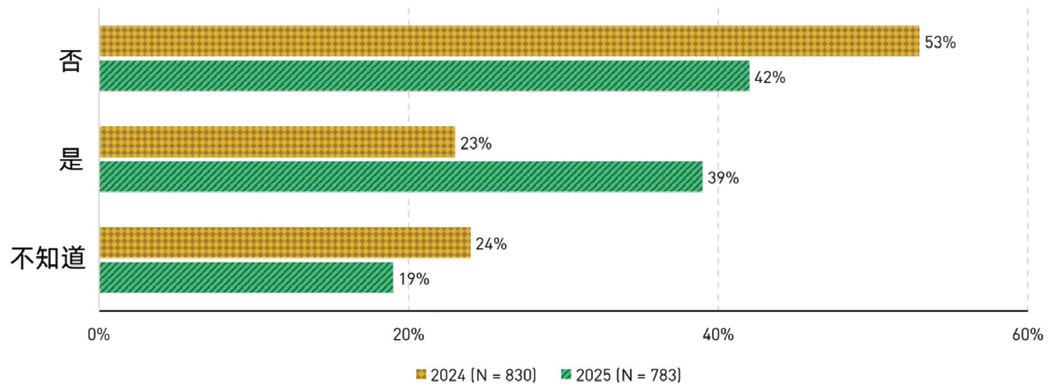

学校政策和指南对于减少许多受访者所担忧的人工智能不当和不道德使用至关重要。尽管大多数受访者(42%)表示其学校目前没有与人工智能相关的可接受使用政策(AUPs),但拥有相关政策的学校比例从去年的23%上升至今年的39%(如图3)。

图3 学校的人工智能相关可接受使用政策

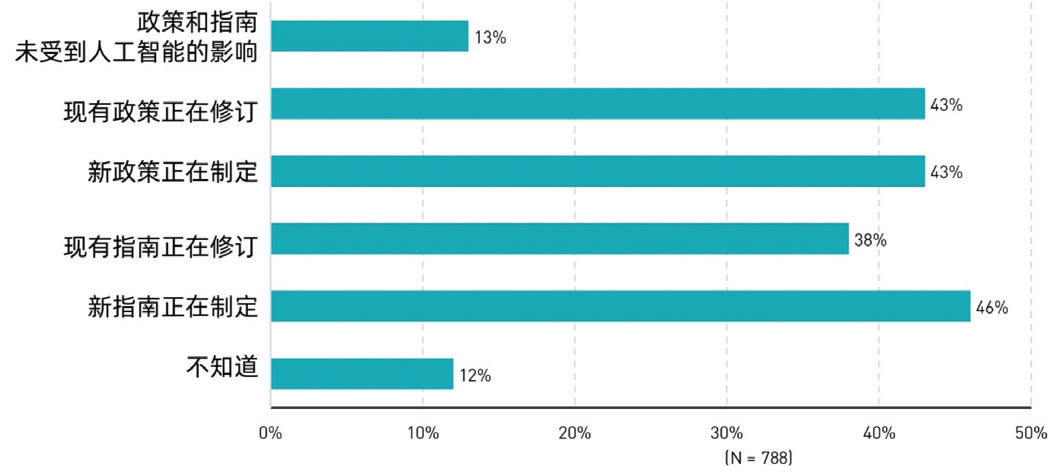

从更广泛的角度来看这个问题,只有少数受访者(13%)表示,其学校的政策和指南没有受到人工智能的影响,绝大多数学校要么制定新的政策和指南,要么修订现有政策,以适应新的人工智能相关问题和应用场景(如图4)。

图4 人工智能对学校政策和指南的影响

应用案例

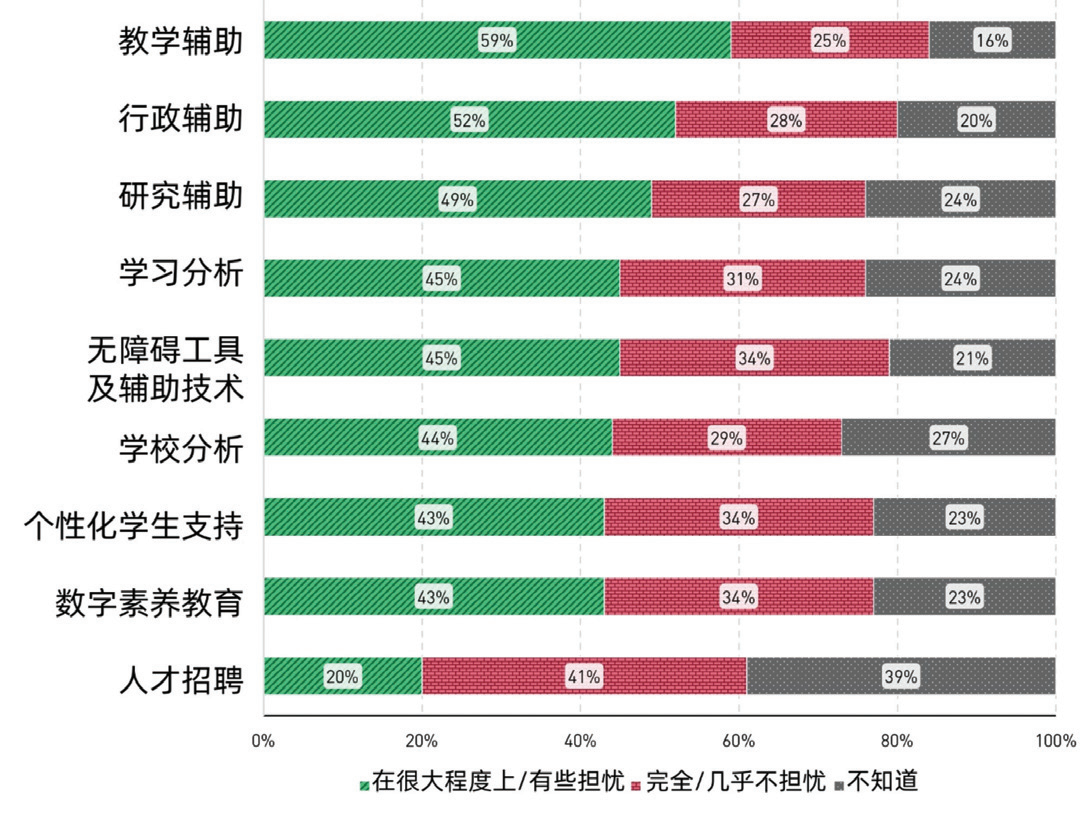

学校所有关键职能中都在使用人工智能。与人工智能在学校其他方面(如政策)的影响一致,教学是学校最有可能应用人工智能的职能领域(59%),紧随其后的是行政管理(52%)(如图5)。

图5 学校在关键职能中使用人工智能的关注程度

当被要求比较学生和教师对人工智能的使用情况时,68%的受访者表示,学生使用人工智能的频率比教师“略高”或“高得多”,只有3%的受访者表示教师使用人工智能的频率高于学生(如图6)。这种利益相关者在人工智能使用上的明显不平衡令人惊讶,尤其是考虑到前面提到的学校在人工智能相关战略中更倾向于关注教师培训(63%)而非学生培训(41%)。

图6 学生和教师人工智能使用情况的比

员工队伍

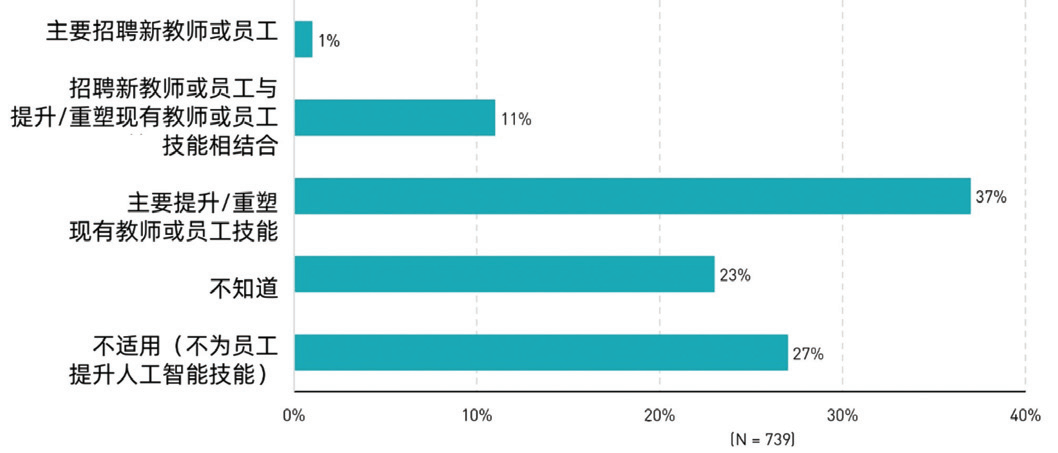

学校主要通过提升现有员工技能来适应人工智能相关工作。当被问及人工智能相关工作职责时,61%的受访者表示,他们具有与人工智能相关的工作职责,而2024年这一比例为56%。在开放性评论中,受访者描述了人工智能相关任务涵盖学校的各个领域,从教学、学生服务到日常运营。事实上,“现有员工承担人工智能相关职责”似乎是许多学校满足人工智能相关人员需求的方式。只有1%的受访者表示其学校主要通过招聘新教师或员工来满足人工智能相关技能需求,而37%的受访者表示其学校通过提升或重塑现有教师或员工的技能来满足这些需求(如图7)。值得注意的是,超过四分之一(27%)的受访者表示其学校没有为员工提升人工智能相关技能。除了提升和重塑现有教师或员工的技能,一些学校还在创建新的非领导和领导职位,或对现有职位进行重组,且这一比例高于2024年。

图7 学校提升员工人工智能相关技能的方式

特别关注:学校间的人工智能数字鸿沟

报告显示,成功采用人工智能需要大量的资源和能力,包括资金、人员配备、领导力、战略和运营稳健性、技术和数据基础设施等。部分学校比其他学校更容易获得这些资源和能力。因此,我们将关注一种似乎正在扩大的人工智能数字鸿沟,这一鸿沟体现在当前的实践和资源,以及长期规划和适应新兴人工智能格局的准备程度上。

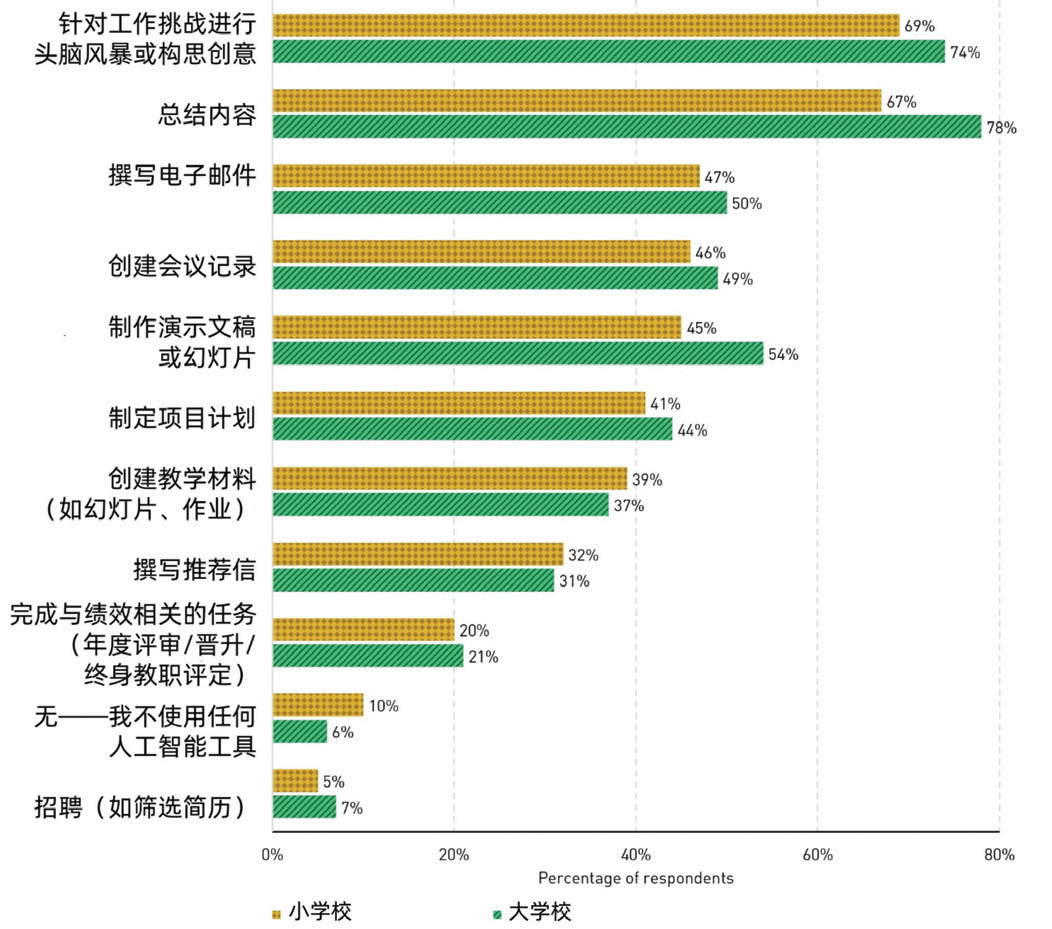

大型和小型学校在人工智能方面的兴趣相似。我们首先观察到,来自大型学校(即学生人数达10,000人以上)和小型学校(即学生人数少于5,000人)的受访者在个人使用人工智能技术的情况、采用人工智能技术的动机,以及对未来人工智能技术的期望方面,并没有显著差异。相反,大型和小型学校的受访者使用人工智能工具用于个人目的的比例大致相同(如图8),只有“总结内容”和“制作演示文稿或幻灯片”这两项应用的比例差距超过5%。同时,只有10%的小型学校受访者和6%的大型学校受访者表示根本不使用任何人工智能工具。

图8 按学校规模划分的人工智能使用情况

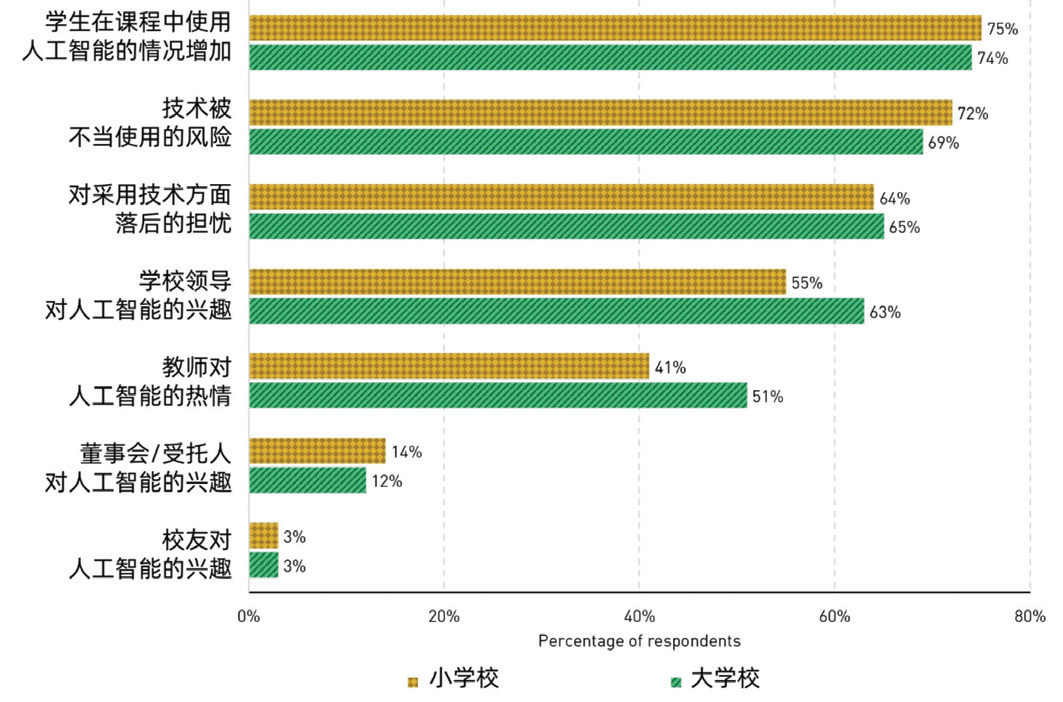

大型和小型学校的受访者在人工智能相关战略规划的动机方面也有相似的优先级(如图9),“学生在课程中使用人工智能的情况增加”和“这些技术被不当使用的风险”是两组受访者的前两大动机。

图9 按学校规模划分的人工智能相关战略规划主要动机

建议

1、基于这些数据带来的启示,学校可以采取以下行动:

加强对学生的培训,确保学校对学生培训投入的资源和精力,与学校对教师和员工的培训相平衡。

收集学校层面的政策和指南范例,与学校领导分享,以促进围绕人工智能的整体性规划和管理。

盘点学校正在使用的常见人工智能工具,探索通过许可或自研的方式,更有效、安全地获取和管理常见人工智能解决方案。

对于小型学校,与同行学校建立联系,重点关注资源共享、知识和标准开发,以及商业和战略规划指导。

对于大型学校,制定计划系统记录采用和管理人工智能的挑战与成功经验,并与高等教育领域的同行分享。

2、调查受访者也提出了一些行动建议。在开放性评论中,受访者描述了其学校为减轻人工智能相关风险所采取的措施:

制定指南和政策。

对新技术进行广泛审查,让学校各利益相关者(如隐私、安全部门人员)参与其中。

对教师、员工和学生进行培训。

通过专业网络共享最佳实践。

建立人工智能治理机制。

实施与人工智能相关的学术诚信政策。

改变评估方式(如要求学生展示创作过程)。

使用“围墙花园”式人工智能(如开发自研人工智能软件、使用本地服务器)。

开展风险评估。

打破部门壁垒进行协作(如成立跨学科委员会和工作组)。

提升学校灵活性,推行“快速试错、迭代优化”策略,大范围培养人工智能能力。

让高层管理人员参与人工智能相关战略制定。

通过全校范围的网络安全措施减少攻击面。

提高对政策和程序的认识(如数据治理政策、经过审查的人工智能工具清单)。

收集利益相关者应用案例,为政策和指南制定、新的支持措施、预算编制等提供参考。

来源:EDUCAUSE

作者:Jenay Robert,Mark McCormack

翻译:李想(南开大学)

责编:项阳

特别声明:本站注明稿件来源为其他媒体的文/图等稿件均为转载稿,本站转载出于非商业性的教育和科研之目的,并不意味着赞同其观点或证实其内容的真实性。如转载稿涉及版权等问题,请作者在两周内速来电或来函联系。

相关阅读

EDUCAUSE精选:小型高校AI部署五大行动2025/05/06

EDUCAUSE:应对高等教育的人工智能伦理困境2025/03/12

EDUCAUSE:高校数据集中化支撑决策 促进转型2025/02/14

EDUCAUSE:首席信息官的挑战2024/12/09

2025 EDUCAUSE十大教育话题发布:对高等教育重建信任2024/11/26

EDUCAUSE:人工智能新世界中必备的三大技能2024/11/14

EDUCAUSE:人工智能时代的大学教学变革2024/11/06

EDUCAUSE:没有数据治理就无法实现数字化转型2024/10/14

EDUCAUSE:应对高等教育的人工智能伦理困境2025/03/12

EDUCAUSE:高校数据集中化支撑决策 促进转型2025/02/14

EDUCAUSE:首席信息官的挑战2024/12/09

2025 EDUCAUSE十大教育话题发布:对高等教育重建信任2024/11/26

EDUCAUSE:人工智能新世界中必备的三大技能2024/11/14

EDUCAUSE:人工智能时代的大学教学变革2024/11/06

EDUCAUSE:没有数据治理就无法实现数字化转型2024/10/14

一起关注互联网发展、互联网技术、互联网体系结构……

在教育部科技司领导下,中央电化教育馆组织实施了教育信息化教学应用实践共同体项目...

工作要点聚焦:教育信息化、网络安全……都怎么干?

京公网安备 11040202430174号

京公网安备 11040202430174号